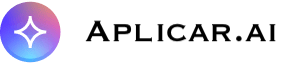

将近七年来,AI基础设施版图一直保持固定格局。OpenAI构建前沿模型,微软Azure是唯一合法托管它们的超大规模云服务商,而AWS和谷歌云只能在边缘竞争。2026年4月27日,这张版图被重新绘制。

OpenAI与微软重新谈判了合作关系,终止了Azure的独占权。不到24小时后,AWS在Amazon Bedrock上以有限预览形式发布了OpenAI的前沿模型——包括GPT-5.5和Codex编程智能体,并将在数周内全面上线。

这并非一次常规的合作更新。这是多云AI从例外情况转变为默认架构的时刻。

1. 2026年4月27日到底发生了什么变化

之前

- OpenAI的API产品由微软Azure独家提供。

- 微软通过AGI条款对OpenAI的全部知识产权拥有“优先购买权”。

- 企业若想使用GPT,实际上必须采购Azure。

之后

- OpenAI可以自由地在任何云上提供其模型——首先在AWS上,据称谷歌云认证计划在2026年第四季度完成。

- 微软仍然是OpenAI的“主要云合作伙伴”,并保留至2032年的OpenAI知识产权非独占许可。

- 微软在2030年前仍可获得20%的收入分成,但现受限于未公开的上限。

- OpenAI仍需先将新前沿模型部署在Azure上,然后才能出现在竞争云平台上。

- 一旦达到AGI就会改变商业关系的争议性AGI条款已被废除。

简而言之:微软不再是守门人,但也远未被边缘化。两家公司都从中获益。

2. 为什么AWS在一周内迅速行动——以及它为何已做好准备

AWS并非临时起意。基础早在两笔巨额交易中就已奠定:

- 2025年11月:一项380亿美元、为期七年的算力承诺,使OpenAI能够使用Amazon EC2 UltraServer中的数十万块NVIDIA GB200和GB300 GPU。

- 2026年2月:一笔单独的500亿美元亚马逊对OpenAI的投资,并附带超过1000亿美元、为期八年的云服务承诺。关键的是,这笔交易还要求OpenAI在AWS自研Trainium芯片上运行工作负载,并共同在Bedrock上开发“有状态运行时环境”。

因此,当微软的独占权解除时,AWS的基础设施、合同和集成层已经准备就绪。AWS首席执行官Matt Garman在发布会上直言不讳地总结道:企业客户的生产应用程序、数据和安全态势早已存在于AWS中——他们之前只是被迫离开这个环境才能使用OpenAI的最佳模型。

3. Bedrock上实际发布了什么

同时发布了三样东西:

- OpenAI的前沿模型(包括GPT-5.5和GPT-5.4),可通过企业已在使用的相同Bedrock API——InvokeModel、Converse和批量推理——进行调用,并复用现有的IAM策略、护栏和知识库。

- OpenAI Codex,编程智能体,直接集成到AWS环境中。

- Amazon Bedrock Managed Agents powered by OpenAI,一个跨交互保留记忆的企业级智能体平台。这是两家公司在2月份宣布的“有状态运行时环境”的产品化形式。

架构意义在于:OpenAI推理成为AWS基础设施的一部分,而非外部API调用。这意味着更低的延迟、无跨云出站费用、原生的AWS安全特性(IAM、PrivateLink、加密、CloudTrail日志记录),以及合规矩阵中少了一个供应商。

4. Trainium的故事——承诺与现实

更长远的故事是芯片。AWS并不满足于只做NVIDIA GPU的房东。凭借在2025年re:Invent上发布的、采用3纳米工艺的Trainium3,AWS正在做出迄今为止最可信的努力,以打破NVIDIA的定价权。

诚实的对比

| 指标 | Trainium3 | NVIDIA Blackwell Ultra (GB300) |

|---|---|---|

| 每芯片FP8性能 | ~2.52 PFLOPS | ~5 PFLOPS |

| 每芯片HBM | 144 GB HBM3e | 288 GB HBM3e |

| 系统总性能(最大) | 362 PFLOPS (Trn3 UltraServer, 144芯片) | ~540 PFLOPS (GB300 NVL72) |

| 工艺节点 | 台积电3纳米 | 台积电4NP |

| 最佳应用场景 | FP8训练,系统级TCO | FP4推理,原始每芯片算力 |

从每芯片来看,NVIDIA仍然胜出——原始FP8吞吐量大约高出2倍。AWS并未否认这一点。其卖点有所不同:据SemiAnalysis称,Trainium3在每标称FP8性能上的TCO比GB300 NVL72大约好30%,能效比上一代提高4倍。然而,在FP4推理方面,NVIDIA的优势要大得多。

战略意义

AWS正在执行与苹果运行Apple Silicon相同的策略:设计芯片,拥有云,托管模型,销售平台。Trainium不会在所有工作负载上取代NVIDIA——OpenAI的380亿美元AWS交易仍主要使用NVIDIA GPU。但对于高容量推理以及能效和总成本比峰值每芯片算力更重要的训练任务,Trainium为AWS提供了利润率空间,而Azure和谷歌云要么通过TPU(谷歌)匹配,要么支付NVIDIA零售价(微软)来与之竞争。

Rainier项目——一个包含50万块Trainium2芯片、用于训练Anthropic Claude模型的集群——已经证明了Trainium可以在生产环境中运行前沿级别的负载。随着OpenAI在2月交易中承诺使用Trainium,AWS有了第二个锚定租户。

5. 这对微软的真正意义

认为微软“输了”的说法过于简单。微软用独占权换来了现金确定性和产品自主权。

微软放弃了什么

- OpenAI商业产品的独家托管权。

- 独特的企业锁定论据:“要使用GPT,必须购买Azure”。

- 本会改变商业关系的AGI触发条款。

微软保留(或获得)了什么

- 至2032年的非独占知识产权许可——再获得六年的保证访问权限。

- 2030年前20%的收入分成(设有上限,但仍可能价值数十亿美元)。

- “首发”权:OpenAI的新前沿模型仍将在其他云平台之前首发于Azure。

- 停止为Azure托管的模型向OpenAI支付收入分成。

- Copilot、必应和Microsoft 365集成——这是使OpenAI对大多数企业最有用的消费者和生产力界面层。

微软从“唯AI云”转变为“最集成的AI云”。这在叙事上是降级,但在收入上不一定。

6. 谷歌云、Anthropic及其他选手

谷歌云据称正在研究新合同条款,以了解可能性。无论OpenAI是否会落地GCP,谷歌的策略保持不变:依靠Gemini和TPU实现差异化,而非依赖他人的模型。

Anthropic是隐秘的赢家。就在OpenAI交易达成前几周,亚马逊对其原始AI合作伙伴追加了高达250亿美元的投资和超过1000亿美元的云承诺。Bedrock现在同时托管Claude和GPT——这一独特地位让AWS可以将“模型中立”作为卖点。

阿里云和中国超大规模云服务商在很大程度上不受这次西方格局重组的影响。他们的游戏是主权和国内模型栈。

7. 真正转变:从模型获取之争到基础设施效率之争

三年来,企业AI采购一直被一个问题主导:哪个云有我需要的模型?

这个问题现在已经过时了。新问题是:哪个云能在最佳价格、延迟、治理和工具链下运行我想要的模型?

竞争转向了更难伪装的维度:

- 自研芯片——Trainium vs. Nvidia vs. TPU vs. 微软Maia芯片的未来形态。

- 编排层——Bedrock vs. Azure AI Foundry vs. Vertex AI。

- 规模化下每Token成本,尤其是推理方面。

- 多模型智能体平台——新的Bedrock Managed Agents是这方面的开篇之作。

- 企业治理——可观测性、评估、微调流程、混合部署。

8. 为什么AWS结构性地处于有利地位——但并非不可战胜

AWS进入这个新阶段,拥有罕见的组合:

- 全球最大的云基础设施覆盖,大多数企业数据已存在于其中。

- 一个真正多模型的平台(OpenAI、Anthropic、Meta、Mistral、Cohere、亚马逊自家的Nova)整合在同一编排层内。

- 在TCO上具有竞争力(即使在每芯片峰值性能上不敌对手)的自研芯片。

- 深厚的企业工具链——IAM、VPC、合规性——难以撼动。

不过,风险真实存在。每芯片性能仍然偏向NVIDIA,CUDA的软件护城河仍是行业中最深的。微软保留了AI使用最广泛的消费者和生产力界面。而OpenAI现在有充分的动力让各超大规模云服务商在价格上相互竞争。

最终总结

2026年4月的OpenAI-AWS发布是一个转折点——但并非大多数头条新闻暗示的那种。微软没有输;它用垄断地位换来了一个更可持续的地位。AWS没有“赢得”OpenAI;它花了380亿美元外加500亿美元股权买到了一个席位。而Trainium并未取代NVIDIA;它赢得了继续竞争的资格。

真正结束的是这样一个时代:获取单一模型就能定义云策略。从现在起,AI云市场将由基础设施效率、多模型编排和芯片经济学来决定。这比独占权的游戏要难得多——也更有趣得多。

来源:AWS、路透社、CNBC、GeekWire、TechCrunch、Axios、The New Stack、SemiAnalysis、Tom’s Hardware(2026年4-5月报道及2025年re:Invent披露信息)。