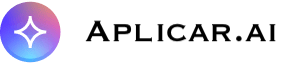

Durante casi siete años, el mapa de la infraestructura de IA tuvo una forma fija. OpenAI construía los modelos de frontera, Microsoft Azure era el único hiperescalador legalmente autorizado para alojarlos, y AWS y Google Cloud competían en los márgenes. El 27 de abril de 2026, ese mapa fue redibujado.

OpenAI y Microsoft renegociaron su alianza para terminar con la exclusividad de Azure. Menos de 24 horas después, AWS lanzó los modelos de frontera de OpenAI — incluyendo GPT-5.5 y el agente de codificación Codex — en Amazon Bedrock en vista previa limitada, con disponibilidad general desplegándose en pocas semanas.

Esta no es una actualización rutinaria de alianza. Es el momento en que la IA multi-nube deja de ser la excepción y comienza a convertirse en la arquitectura predeterminada.

1. Qué cambió realmente el 27 de abril de 2026

Antes

- Los productos API de OpenAI eran exclusivos de Microsoft Azure.

- Microsoft tenía una posición de «primera opción de rechazo» sobre toda la propiedad intelectual de OpenAI a través de la cláusula AGI.

- Si una empresa quería GPT, efectivamente tenía que comprar Azure.

Después

- OpenAI es libre de servir sus modelos en cualquier nube — comenzando con AWS, con la certificación de Google Cloud supuestamente dirigida para el Q4 2026.

- Microsoft sigue siendo el «socio principal de nube» de OpenAI y mantiene una licencia no exclusiva de la IP de OpenAI hasta 2032.

- Microsoft aún obtiene un 20% de participación en ingresos hasta 2030, ahora sujeto a un tope no divulgado.

- OpenAI aún debe lanzar nuevos modelos de frontera en Azure primero, antes de que aparezcan en nubes competidoras.

- La controvertida cláusula AGI que habría cambiado la relación comercial una vez que se alcanzara la AGI ha sido eliminada.

En resumen: Microsoft ya no es el guardián, pero está lejos de quedar relegado. Ambas compañías salieron con victorias.

2. Por qué AWS se movió en la misma semana — y por qué estaba listo

AWS no improvisó esto. Los cimientos se establecieron a través de dos acuerdos enormes:

- Noviembre 2025: Un compromiso de cómputo de $38 mil millones por siete años que le da a OpenAI acceso a cientos de miles de GPUs NVIDIA GB200 y GB300 en Amazon EC2 UltraServers.

- Febrero 2026: Una inversión separada de Amazon de $50 mil millones en OpenAI, emparejada con un compromiso de nube valorado en más de $100 mil millones durante ocho años. Críticamente, este acuerdo también compromete a OpenAI a ejecutar cargas de trabajo en chips Trainium personalizados de AWS y a co-desarrollar un «Entorno de Tiempo de Ejecución con Estado» en Bedrock.

Así que cuando cayó la exclusividad de Microsoft, AWS ya tenía la infraestructura, los contratos y la capa de integración listos. El CEO de AWS Matt Garman lo resumió sin rodeos en el evento de lanzamiento: las aplicaciones de producción de clientes empresariales, datos y postura de seguridad ya vivían en AWS — simplemente habían sido forzados a abandonar ese entorno para usar los mejores modelos de OpenAI.

3. Qué se está enviando realmente en Bedrock

Tres cosas se lanzaron juntas:

- Los modelos de frontera de OpenAI (incluyendo GPT-5.5 y GPT-5.4), llamables a través de las mismas APIs de Bedrock que las empresas ya usan — InvokeModel, Converse, e inferencia por lotes — y reutilizando políticas IAM existentes, barreras de protección y bases de conocimiento.

- OpenAI Codex, el agente de codificación, integrado directamente en entornos AWS.

- Amazon Bedrock Managed Agents potenciado por OpenAI, una plataforma de agente empresarial que retiene memoria a través de interacciones. Esta es la forma productizada del «Entorno de Tiempo de Ejecución con Estado» que las dos compañías anunciaron en febrero.

La importancia arquitectónica: la inferencia de OpenAI se convierte en parte de la infraestructura de AWS en lugar de una llamada de API externa. Eso significa menor latencia, sin tarifas de egreso entre nubes, seguridad nativa de AWS (IAM, PrivateLink, encriptación, registro de CloudTrail), y un proveedor menos en la matriz de cumplimiento.

4. La historia de Trainium — promesa y realidad

La historia a largo plazo es el silicio. AWS no se conforma con ser arrendador de GPUs de Nvidia. Con Trainium3, lanzado en re:Invent 2025 en un proceso de 3 nm, AWS está haciendo su intento más creíble hasta ahora de romper el poder de precios de Nvidia.

La comparación honesta

| Métrica | Trainium3 | NVIDIA Blackwell Ultra (GB300) |

|---|---|---|

| FP8 por chip | ~2.52 PFLOPS | ~5 PFLOPS |

| HBM por chip | 144 GB HBM3e | 288 GB HBM3e |

| Total del sistema (máx) | 362 PFLOPS (Trn3 UltraServer, 144 chips) | ~540 PFLOPS (GB300 NVL72) |

| Nodo de proceso | TSMC 3 nm | TSMC 4NP |

| Mejor en | Entrenamiento FP8, TCO a nivel de sistema | Inferencia FP4, cómputo bruto por chip |

Por chip, Nvidia aún gana — aproximadamente 2x en rendimiento FP8 bruto. AWS no está fingiendo lo contrario. El argumento de venta es diferente: Trainium3 supuestamente entrega aproximadamente 30% mejor TCO por rendimiento FP8 comercializado que GB300 NVL72 (según SemiAnalysis), con 4x mejor eficiencia energética que la generación anterior. En inferencia FP4, sin embargo, la ventaja de Nvidia es mucho mayor.

Qué significa esto estratégicamente

AWS está ejecutando la misma estrategia que Apple ejecutó con Apple Silicon: diseñar el chip, poseer la nube, alojar los modelos, vender la plataforma. Trainium no desplazará a Nvidia para cada carga de trabajo — y el acuerdo de $38B de OpenAI con AWS sigue siendo principalmente GPUs de Nvidia. Pero para inferencia de alto volumen y para ejecuciones de entrenamiento donde la energía y el costo total importan más que el cómputo pico por chip, Trainium le da a AWS margen de maniobra que Azure y Google Cloud tienen que igualar ya sea con TPUs (Google) o pagando a Nvidia al por menor (Microsoft).

Proyecto Rainier — un clúster de 500,000 chips Trainium2 entrenando modelos Claude de Anthropic — ya probó que Trainium puede ejecutar cargas de trabajo a escala de frontera en producción. Con OpenAI ahora comprometido contractualmente con Trainium bajo el acuerdo de febrero, AWS tiene su segundo inquilino ancla.

5. Qué significa esto realmente para Microsoft

La narrativa de que Microsoft «perdió» es demasiado simple. Microsoft intercambió exclusividad por certeza de efectivo y autonomía de producto.

Lo que Microsoft renunció

- Derechos exclusivos de alojamiento para los productos comerciales de OpenAI.

- El argumento único de bloqueo empresarial: «tienes que comprar Azure para obtener GPT.»

- La cláusula disparadora de AGI que habría alterado la relación comercial.

Lo que Microsoft mantuvo (o ganó)

- Licencia de IP no exclusiva hasta 2032 — seis años más de acceso garantizado.

- 20% de participación en ingresos hasta 2030 (con tope, pero aún probablemente valdrá miles de millones).

- Derechos de «primer envío»: nuevos modelos de frontera de OpenAI aún debutan en Azure antes que cualquier otra nube.

- Deja de pagar participación en ingresos de vuelta a OpenAI por modelos servidos en Azure.

- Integración con Copilot, Bing y Microsoft 365 — el área de superficie de consumidor y productividad que hace a OpenAI más útil para la mayoría de las empresas.

Microsoft pasa de ser «la única nube de IA» a ser «la nube de IA más integrada.» Esa es una degradación en narrativa pero no necesariamente en ingresos.

6. Google Cloud, Anthropic, y el resto del campo

Google Cloud supuestamente está estudiando los nuevos términos del contrato para ver qué es posible. Ya sea que OpenAI llegue o no a GCP, la estrategia de Google permanece igual: diferenciarse en Gemini y TPUs en lugar de depender de los modelos de alguien más.

Anthropic es el ganador silencioso. Amazon dobló la apuesta en su socio de IA original justo semanas antes del acuerdo con OpenAI, con hasta $25 mil millones en inversión adicional y un compromiso de nube de más de $100 mil millones propio. Bedrock ahora aloja tanto Claude como GPT lado a lado — una posición inusual que le permite a AWS vender la «neutralidad de modelos» como una característica.

Alibaba Cloud y los hiperescaladores chinos están en gran medida aislados de esta reorganización occidental. Su juego es la soberanía y la pila de modelos domésticos.

7. El cambio real: de guerras de acceso a modelos a guerras de eficiencia de infraestructura

Durante tres años, la adquisición de IA empresarial estuvo dominada por una pregunta: ¿qué nube tiene el modelo que necesito?

Esa pregunta ahora es obsoleta. La nueva pregunta es: ¿qué nube ejecuta el modelo que quiero con el mejor precio, latencia, gobernanza y herramientas?

La competencia se desplaza a dimensiones que son mucho más difíciles de fingir:

- Silicio personalizado — Trainium vs. Nvidia vs. TPUs vs. lo que sea que se conviertan los chips Maia de Microsoft.

- Capas de orquestación — Bedrock vs. Azure AI Foundry vs. Vertex AI.

- Costo por token a escala, especialmente para inferencia.

- Plataformas de agentes multi-modelo — los nuevos Bedrock Managed Agents son el primer disparo aquí.

- Gobernanza empresarial — observabilidad, evaluaciones, pipelines de ajuste fino, despliegues híbridos.

8. Por qué AWS está estructuralmente bien posicionado — pero no es invencible

AWS entra a esta nueva fase con una combinación rara:

- La huella de nube más grande globalmente, donde ya viven la mayoría de datos empresariales.

- Una plataforma genuinamente multi-modelo (OpenAI, Anthropic, Meta, Mistral, Cohere, la propia Nova de Amazon) dentro de una capa de orquestación.

- Silicio personalizado que es competitivo en TCO incluso si no en rendimiento pico por chip.

- Herramientas empresariales profundas — IAM, VPC, cumplimiento — que son difíciles de desalojar.

Los riesgos son reales, sin embargo. El rendimiento por chip aún favorece a Nvidia, y el foso de software de CUDA sigue siendo el más profundo en la industria. Microsoft retiene la superficie de consumidor y productividad donde la IA se usa más. Y OpenAI mismo ahora tiene todo incentivo para enfrentar a los hiperescaladores entre sí en precio.

Conclusión final

El lanzamiento de OpenAI–AWS de abril de 2026 es un punto de inflexión — pero no el que sugieren la mayoría de titulares. Microsoft no perdió; intercambió una posición de monopolio por una más sostenible. AWS no «ganó» OpenAI; compró un asiento en la mesa por $38 mil millones más otros $50 mil millones en capital. Y Trainium no desplazó a Nvidia; se ganó el derecho de seguir compitiendo.

Lo que realmente terminó es la era cuando el acceso a un solo modelo podía definir la estrategia de nube. De aquí en adelante, el mercado de nube de IA será decidido por la eficiencia de infraestructura, orquestación multi-modelo, y economías de silicio. Ese es un juego mucho más difícil que la exclusividad — y uno mucho más interesante de observar.

Fuentes: AWS, Reuters, CNBC, GeekWire, TechCrunch, Axios, The New Stack, SemiAnalysis, Tom’s Hardware (reportajes de abril–mayo 2026 y divulgaciones de re:Invent 2025).